Crawl Budget SEO: Qué es y cómo optimizarlo para mejorar el posicionamiento web

¿Qué es el Crawl Budget en SEO?

El crawl budget o presupuesto de rastreo es un concepto fundamental en el SEO técnico que hace referencia a la cantidad de recursos (tiempo y número de páginas) que los motores de búsqueda, principalmente Googlebot, asignan para rastrear un sitio web en un periodo determinado. Un manejo óptimo de este presupuesto puede significar la diferencla entre que tus páginas clave sean indexadas rápidamente o que queden ignoradas durante días o incluso semanas.

Gestionar el crawl budget es cada vez más crucial, especialmente en sitios grandes y ecommerces con miles de URLs, pero también es relevante en webs medianas o pequeñas cuando existen problemas de rastreo, duplicidad de contenidos o problemas de enlazado interno.

Componentes del Crawl Budget

El presupuesto de rastreo se determina principalmente a partir de dos factores:

- La capacidad de rastreo (Crawl Rate Limit): Es la cantidad máxima de conexiones y peticiones que Googlebot puede hacer a tu servidor sin afectar su rendimiento. Si tu servidor responde lenta o inestablemente, Google reducirá la frecuencia de rastreo.

- La demanda de rastreo (Crawl Demand): Es la frecuencia con la que los bots quieren rastrear tu sitio basándose en la popularidad (enlaces externos y demanda de los usuarios) y la actualización de las páginas (contenido nuevo o modificado).

Una correcta gestión del crawl budget implica optimizar ambos factores para lograr un mayor índice de rastreo y prioridad en el indexado de páginas importantes.

¿Por qué es importante optimizar el Crawl Budget?

Optimizar el crawl budget tiene implicaciones directas en el rendimiento SEO de tu web:

- Indexación más rápida de contenidos clave: Si tus nuevas páginas o actualizaciones se rastrean pronto, aparecerán antes en los resultados de búsqueda.

- Mejor detección de errores SEO: Un rastreo eficiente permite identificar y corregir errores como contenido duplicado, redirecciones innecesarias o páginas no indexables.

- Aprovechamiento máximo de los recursos de Googlebot: Así, dedicas el crawl budget a tus URLs más importantes, evitando el desperdicio en páginas irrelevantes.

Factores que afectan al Crawl Budget

Calidad de la arquitectura web

La estructura interna y la jerarquía de URL influyen notablemente en la distribución del crawl budget. Un enlazado interno óptimo permite que Googlebot descubra y priorice eficazmente tus páginas más relevantes, mientras que las páginas huérfanas o de baja calidad pueden consumir presupuesto sin aportar valor.

Velocidad y rendimiento del servidor

El tiempo de respuesta del servidor es un factor crítico. Si el servidor responde lento o lanza errores 5xx, Google reducirá su ritmo de rastreo para no saturar tu web, lo que reduce la frecuencia con la que se rastrean tus páginas. Monitoriza siempre los logs y el estado del servidor utilizando herramientas como Google Search Console, Screaming Frog Log File Analyser o DeepCrawl.

Number de URLs indexables

Cuantas más URLs tengan potencial de ser indexadas, mayor será la complejidad para la gestión del presupuesto. Las páginas duplicadas, thin content o parámetros innecesarios pueden aumentar dramáticamente el número de URLs y diluir el crawl budget, por lo que se recomienda el uso de canónicos, directivas robots.txt y herramientas como Ahrefs o Semrush para identificar estos problemas.

Actualización del contenido

Googlebot prioriza rastrear sitios y páginas que presentan cambios frecuentes. Si tu web apenas se actualiza, el bot disminuirá la frecuencia con la que la rastrea. Por tanto, publicar nuevos contenidos de forma regular y actualizar los existentes favorece un mayor crawl budget efectivo.

Popularidad de la web

Las páginas con mayor popularidad y enlaces externos suelen ser rastreadas con mayor frecuencia, pues Google las percibe como más relevantes. Incrementar la autoridad y los enlaces entrantes tiene también impacto en la demanda de rastreo.

Configuración de robots.txt y meta robots

Un robots.txt mal configurado puede impedir que Googlebot acceda a páginas relevantes, o, por el contrario, permitir el rastreo de URLs innecesarias. Del mismo modo, las directivas noindex o nofollow pueden ayudar a enfocar los recursos de rastreo hacia contenidos realmente valiosos.

Presencia de errores en sitio

- Bucles de redirección

- Enlaces rotos (404)

- Páginas con contenido pobre

Estos errores afectan la capacidad de rastreo y pueden consumir rápidamente el crawl budget. Por ello son fundamentales los auditorías SEO periódicas y el uso de herramientas como Screaming Frog SEO Spider.

Directivas de crawl-delay

Algunos sitios incluyen la instrucción crawl-delay en robots.txt pensando que así evitan sobrecargar servidores, pero normalmente es innecesaria y limita el potencial de rastreo. Solo deberías usar crawl-delay si el servidor es muy frágil.

Cómo saber si tu crawl budget es óptimo

Uso de Google Search Console

Google Search Console es la principal herramienta gratuita para monitorizar y analizar cómo rastrea Google tu sitio. En la sección de Estadísticas de rastreo podrás ver:

- Páginas rastreadas por día

- Kilobytes descargados por día

- Tiempo medio de descarga de página

Si observas picos de rastreo asociados a aumentos de errores o un descenso sostenido en el número de páginas rastreadas sin motivo aparente, es indicio de un problema en el crawl budget.

Análisis de logs del servidor

El análisis de logs del servidor aporta visibilidad total sobre qué URLs rastrea Googlebot, con qué frecuencia y en qué momentos. Puedes identificar:

- Páginas que reciben demasiadas visitas del bot sin aportar valor

- Errores de rastreo (códigos 404, 503, etc.)

- Listar las páginas realmente prioritarias para optimizar el enlazado interno

Detectar señales de mala gestión

Algunos síntomas claros de que el crawl budget está mal gestionado son:

- Páginas importantes sin rastrear o indexar durante largos periodos

- El bot gasta recursos en parámetros de URLs, páginas de filtro, buscar, etc.

- Elevado número de errores de rastreo o de respuesta lenta en el servidor

Estrategias para optimizar el Crawl Budget

1. Mejorar la arquitectura y enlazado interno

Organiza las URLs de forma que Googlebot pueda encontrar fácilmente las páginas clave, reduciendo la profundidad de clics (click depth) y evitando orfandad.

- Enlazado contextual: Vincula desde páginas con autoridad hacia las más importantes.

- Sitemaps XML: Mantén actualizado el sitemap solo con URLs relevantes y envíalo a GSC.

- Breadcrumbs y menús bien estructurados: Facilita el rastreo de las secciones principales.

2. Eliminar y bloquear URLs innecesarias

Las URLs sin valor SEO, duplicadas o generadas por parámetros deben evitar ser rastreadas:

- Bloquea en robots.txt carpetas y patrones innecesarios: /carrito, /busqueda, /admin, etc.

- Noindex en meta robots para páginas sin interés en resultados de búsqueda (políticas, legal, fichas duplicadas…)

- Usa la herramienta de parámetros de Search Console para controlar el rastreo de URLs con parámetros.

3. Mejorar velocidad de carga y rendimiento

Invierte en servidores rápidos, CDN, compresión y caching. Un sitio que responde bien puede aumentar exponencialmente la frecuencia de rastreo asignada por parte de Googlebot.

4. Reducción de errores de rastreo

Revisa periódicamente en GSC y en el log del servidor posibles códigos de error.

- Corrige enlaces rotos (404) o redirecciones en bucle.

- Configura redirecciones 301 limpias y elimina las cadenas largas de redirects.

5. Disminuir y gestionar contenido duplicado

El contenido duplicado es un gran consumidor de presupuesto de rastreo:

- Cuidado con los parámetros de URL en filtros, paginaciones y atribuciones de campañas (utm…)

- Implementa etiquetas canónicas (

rel="canonical") para consolidar autoridad y rastreo. - Evita múltiple paginación sin sentido y revisa que cada página tenga un propósito real.

6. Actualización constante de contenidos importantes

Mantén actualizadas las páginas prioritarias para incentivar el rastreo y su renovación en el índice. Establece un plan de mejoras y publicación frecuente, actualizando fecha y facilitando la reindexación vía GSC cuando sea necesario.

7. Uso avanzado de Sitemaps XML

- Solo URLs indexables: Evita incluir en los sitemaps URLs 404, redirigidas, en

noindexo bloqueadas por robots.txt. - Divide tu sitemap por secciones: Productos, categorías, blog, etc. Así facilitas la gestión y priorización.

- Manténlo actualizado y asegura que responde con código 200.

Errores comunes que malgastan el Crawl Budget

- Dejar rastrear resultados de búsqueda internos.

- Incluir filtros y paginaciones infinitas sin control.

- Páginas huérfanas inaccesibles por enlazado interno.

- Exceso de parámetros UTM o tracking en URLs visibles.

- Repetición innecesaria de contenido: tags, etiquetas, autores, archivos de fechas…

Este tipo de errores son habituales sobre todo en ecommerces (Shopify, Prestashop, WooCommerce), portales de clasificados y medios, donde la generación masiva de URLs puede desbordar fácilmente cualquier presupuesto de rastreo si no se controla.

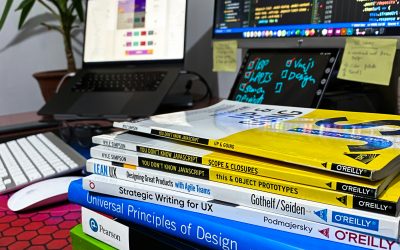

Herramientas clave para la gestión del Crawl Budget

- Google Search Console (estadísticas de rastreo, coberturas).

- Screaming Frog (análisis de arquitectura, paginaciones, duplicados, canónicos, robots… ).

- Screaming Frog Log File Analyser y DeepCrawl (análisis/bloqueo de logs del servidor).

- Ahrefs y Semrush (identificación de páginas populares, enlaces y demanda de rastreo).

- Herramienta de parámetros de Google Search Console para controlar el rastreo por parámetros en URLs.

Utilizar varias de estas herramientas en paralelo garantiza que tanto la monitorización como la optimización del crawl budget sean eficaces y basadas en datos objetivos.

Crawl Budget en sitios pequeños vs. grandes

Sitios pequeños

En webs de tamaño reducido (menos de 500 URLs) no suele haber problemas de presupuesto de rastreo, aunque es esencial evitar errores de crawling y duplicidad. La prioridad aquí es garantizar una arquitectura clara y que todas las URLs sean fácilmente accesibles.

Sitios grandes o ecommerce

En webs grandes, el foco debe estar en reducir la generación automática de URLs (filtros, variantes, combinaciones, etc.), optimizar la calidad del enlazado interno y auditar frecuentemente los logs.

Centrarse en:

- Evitar crawl loops, parámetros infinitos y contenido irrelevante

- Priorización de las páginas más rentables

- Separar en secciones y sitemaps por prioridad

- Automatización en el control de últimas URLs rastreadas con scripts propios

Relación entre Crawl Budget y estrategias de SEO técnico

El correcto manejo del crawl budget es la base de cualquier planificación avanzada de SEO técnico. Da igual cuán bueno sea tu contenido o cuánta autoridad alcanza tu dominio, si Googlebot no es capaz de rastrear, indexar y comprender tus páginas más importantes, tu capacidad de posicionar se verá siempre lastrada.

Como parte de una estrategia holística de SEO técnico, el crawl budget debe abordarse junto a otras áreas clave:

- Indexación y rastreo (robots, sitemaps, paginaciones…)

- WPO – Web Performance Optimization (Core Web Vitals, velocidad, caching…)

- Estructura de la información y enlazado interno

- Gestión avanzada de logs y patrones de crawl

Todo ello refuerza la importancia de la interdisciplinariedad en los equipos SEO y la colaboración entre Desarrollo, Sistemas y Estrategia de Contenidos.

Checklist Avanzado para Optimizar el Crawl Budget

- Haz un análisis completo de logs de tu servidor dos veces al año mínimo

- Controla y actualiza tu robots.txt tras cada cambio sustancial en la web

- Reduce la generación automática de parámetros y facetas

- Implementa canónicos correctos en todas las variantes

- Tu sitemap XML solo debe incluir URLs válidas, sin

noindex,404ni redirecciones - Monitoriza en GSC la evolución de cobertura, rastreo y detecta anomalías rápidamente

- Prioriza la actualización constante (dinamismo) de las páginas de mayor valor

Conclusiones: El valor estratégico del Crawl Budget en el SEO

El crawl budget no es simplemente “cuántas páginas puede rastrear Googlebot”, sino una dimensión estratégica del SEO técnico cuyo manejo y optimización puede marcar la diferencia en el rendimiento de tu site. Supone dedicar los esfuerzos del bot a las páginas que realmente generan negocio, y es una de las palancas más infravaloradas (y rentables) en proyectos de gran alcance.

Una gestión avanzada pasa por:

- Reducir al mínimo las URLs prescindibles para no diluir el valor de las optimizaciones

- Capacitar técnicamente a los equipos para auditar logs, robots.txt y sitemaps de manera experta

- Priorizar la experiencia de usuario, el rendimiento y la autoridad para maximizar el impacto del rastreo

Recuerda: puedes tener el mejor contenido del mundo, pero si Google no lo rastrea, nunca rankeará. El control y optimización del crawl budget es esencial para que tu web compita en igualdad de condiciones en el universo del SEO.

Preguntas Frecuentes Sobre Crawl Budget SEO

¿Qué es el crawl budget en SEO?

El crawl budget es la cantidad de recursos que los motores de búsqueda, como Googlebot, asignan para rastrear las páginas de un sitio web en un periodo de tiempo determinado. Determina cuántas y cuáles páginas podrá descubrir e indexar el bot cada vez que visite nuestro sitio. Una buena gestión del crawl budget ayuda a que las páginas importantes se indexen más rápido y a evitar el rastreo de contenidos poco relevantes o duplicados.

¿Qué es la velocidad de rastreo (crawl rate) en SEO?

La velocidad de rastreo o crawl rate es la frecuencia con la que los bots de los motores de búsqueda pueden acceder y consultar las páginas de tu sitio sin afectar el rendimiento del servidor. Si tu servidor responde rápido y bien a las solicitudes, la velocidad de rastreo podrá aumentar, beneficiando la indexación de nuevos contenidos y la renovación de los existentes.

¿Qué significa rastreo (crawl) en SEO?

Rastrear en SEO significa que los bots de los buscadores acceden a las páginas de un sitio web para analizarlas, detectar cambios, seguir enlaces y decidir su indexación en el motor de búsqueda. Sin rastreo no hay indexación ni posibilidad de aparecer en Google u otros buscadores.

¿Cuál es un buen presupuesto SEO (SEO budget)?

El presupuesto SEO o “SEO budget” hace referencia al dinero y los recursos que una empresa o proyecto destina a sus acciones SEO (herramientas, personal, auditorías, desarrollo técnico, linkbuilding…). No hay una cifra cerrada: un buen presupuesto dependerá del tamaño del sitio, sus objetivos de negocio y la competitividad del sector, pero debe ser suficiente como para abordar tanto la optimización técnica como el desarrollo de contenido y la adquisición de autoridad (enlaces).